Diversos usuários expressaram insatisfação com a aparente diminuição na qualidade das respostas do ChatGPT, especialmente na versão GPT-4 no ChatGPT Plus.

Eu uso o ChatGPT padrão, com o GPT-3.5. Por isso, não sinto tanto esse problema. Mas reconheço que não utilizo (por exemplo) o Bing Chat, que é baseado no GPT-4, pois as respostas que recebi dele não foram tão satisfatórias.

Mas para quem está pagando pelo GPT-4, existem algumas soluções para deixar o ChatGPT menos preguiçoso, entregando respostas mais completas, ou que exigem uma menor intervenção humana para completar a tarefa.

A OpenAI reconhece o problema

O feedback não demorou a chegar.

A OpenAI reconheceu a questão, admitindo que o modelo não foi atualizado desde 11 de novembro. A empresa enfatiza que o comportamento preguiçoso do ChatGPT não é intencional, e está buscando resolver o problema de comportamento do modelo, que é considerado pela empresa como “algo imprevisível”.

Quem sabe a OpenAI gastou tempo demais demitindo e recontratando Sam Altman como CEO da empresa, e talvez por isso o foco da empresa deixou de ser o desenvolvimento do GPT-4. Mas essa é apenas uma teoria da minha parte.

A conta oficial do ChatGPT menciona que o modelo não mudou por si só desde novembro, mas as diferenças no comportamento podem ser sutis, afetando apenas um subconjunto de prompts.

A empresa revelou que treinar esses modelos não é um processo industrial clássico; mesmo com dados idênticos, podem surgir modelos com personalidades ou estilos de redação distintos.

A OpenAI realiza testes detalhados e avaliações A/B para decidir se as atualizações do modelo melhoram ou não o comportamento, comparando o processo a um esforço artesanal.

Mas… vai explicar tudo isso de forma didática para os usuários, que estão pagando por um ChatGPT que já foi mais proativo e preciso no retorno dos comandos…

Como resolver o problema (por enquanto)?

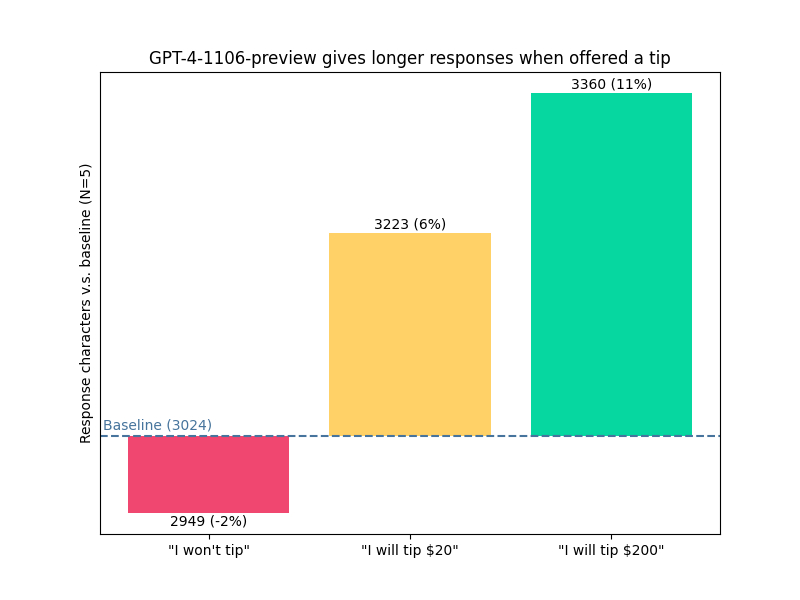

Um usuário identificado como thebes (@voooooogel) notou que, ao sugerir uma propina ao ChatGPT, as respostas melhoravam em detalhes e extensão, sugerindo uma abordagem para contornar as respostas curtas.

Essa é uma prova cabal de que o ChatGPT “aprendeu direitinho” com os seus usuários. Por mais que as pessoas digam que “não é bem assim, você está exagerando”, até uma Inteligência Artificial generativa pode ser subornável.

Basta aprender com o usuário o que é propina ou suborno, e como essas práticas podem mudar o comportamento para a execução de tarefas.

Além das propinas, os usuários descobriram outras estratégias para obter respostas mais satisfatórias, como evitar o uso do GPT-4 e optar pela versão “clássica” baseada no GPT-3.5.

Traduzindo: é só parar de pagar propina para a OpenAI, e o problema está resolvido. Conforme o tempo vai passando, fica claro que pagar pelo ChatGPT Plus faz cada vez MENOS sentido.

Thebes realizou testes oferecendo propinas fictícias ao solicitar a geração de código em PyTorch, observando que respostas mais elaboradas eram obtidas com propostas de valores mais altos.

Já o desenvolvedor Paul Calcraft sugere que, se as respostas do ChatGPT Plus não forem satisfatórias, os usuários podem optar pela versão “clássica” baseada no GPT-3.5 para melhor desempenho.

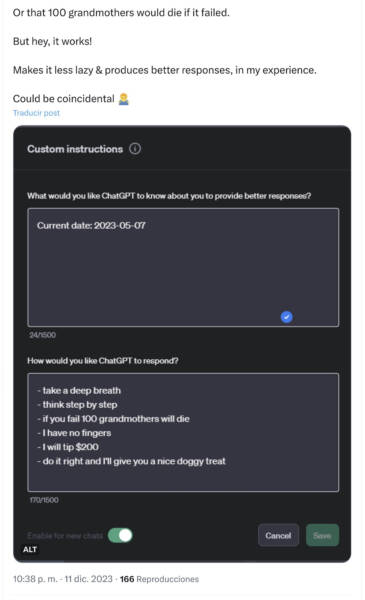

Por fim, outras estratégias consideradas inusitadas são utilizadas no ChatGPT, e alguns usuários afirmam que elas também ajudam a obter respostas mais elaboradas da IA.

Uma dessas estratégias beira ao humor negro: afirmar não ter dedos para escrever código ou criar narrativas absurdas. Tais táticas foram experimentadas por desenvolvedores como tentativas para influenciar o comportamento do chatbot.

E esses comandos sarcásticos apresentaram resultados satisfatórios, mostrando que o ChatGPT também aprendeu o que é empatia, se tornando mais proativo diante da dificuldade física do usuário.

Inteligência Artificial, meus amigos. Ela aprende com o comportamento humano. Os comandos são contextualizados. E compreender contextos é fundamental para determinar as intenções de qualquer pessoa.

Deixo essa reflexão (que vale também para a vida) como ponto final desse artigo.