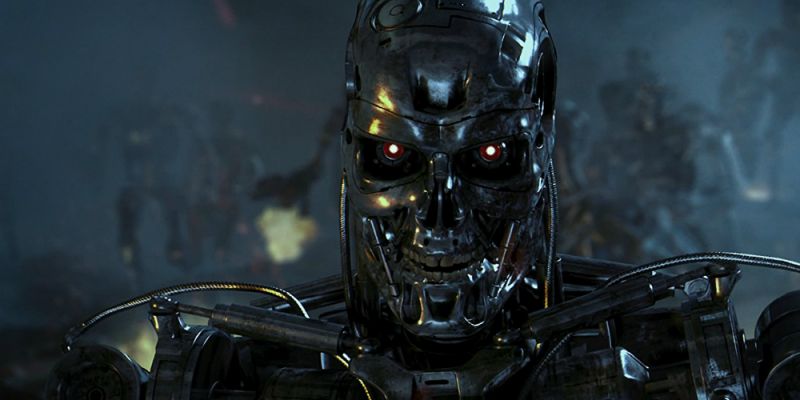

O ser humano confia tanto na tecnologia que acabou desenvolvendo dispositivos que integram Inteligência Artificial que é totalmente focada em matar. Eu nem preciso dizer o quão isso é errado, e agora investigadores afirmam que a única forma de se defender de uma IA assassina é, ao mesmo tempo, da forma mais lógica do mundo: não desenvolvendo uma IA assassina.

A IA é muito mais perigosa do que acreditamos

Um grupo de investigadores da ASRC Federal publicou um documento onde relatam as possíveis consequências do uso da IA na guerra moderna. O texto começa advertindo que a IA vai gerar uma catástrofe antes do que pensamos, em um “acidente” que não seremos capazes de prever.

Os especialistas iniciaram a sua investigação com acidentes como os ocorridos em centrais nucleares, como em Three Mile Island ou Chernobyl. Eles acreditam que a IA representam riscos de acidentes similares, afirmando que encontrar e explorar debilidades para induzir em um comportamento defeituoso vai se transformar em um pilar permanente da estratégia militar do futuro.

Como nos defender de uma IA assassina?

Os cientistas tem claro que o segredo está em não permitir que os robôs possam assassinar humanos com autonomia. Apesar disso, também acreditam que, em um futuro, as máquinas terão uma maior importância nas decisões a serem tomadas.

Eles explicam que os sistemas de IA são muito mais efetivos que os humanos. Por isso, os humanos passarão a ter um papel mais passivo, supervisionando as ações da IA primeiro, para depois serem uma espécie de operador que ativa o interruptor legal. Aquele que pode matar uma pessoa com um simples clique.

Tais armas autônomas e letais vão se expandir muito mais rápido do que imaginamos. As guerras entre máquinas autônomas vão emergir, e os humanos não poderão se envolver de forma manual em atos bélicos, se limitando a realizar análises posteriores em busca de formas para acabar com essa possível guerra e, com sorte, tentar estabelecer a paz.

A perda de controle pode resultar em um grande problema para a raça humana. Os investigadores parecem argumentar que a IA será a perdição do ser humano, caso não apareça uma regulamentação ou proibição para que uma IA possa eventualmente matar.

Pode ser que uma regulamentação seja uma boa ideia, onde no final das contas, a tecnologia sempre pode ser utilizada com fins maléficos. Dá um pouco de medo ao imaginar que terroristas podem transformar um sistema de reconhecimento facial em um sistema de alvos para matar pessoas. Com o passar do tempo, veremos se os pesquisadores tem razão, ou se existe uma grande dose de exagero em torno de tudo isso.

Via The Next Web