A polêmica durou menos do que muitos esperavam. No mesmo dia que Jony Ive anunciou a sua saída da Apple, o DeepNude, site que prometia “desnudar” mulheres com a ajuda da inteligência artificial, tão logo apareceu para o mundo como já morreu. Antes de evitar uma avalanche de processos.

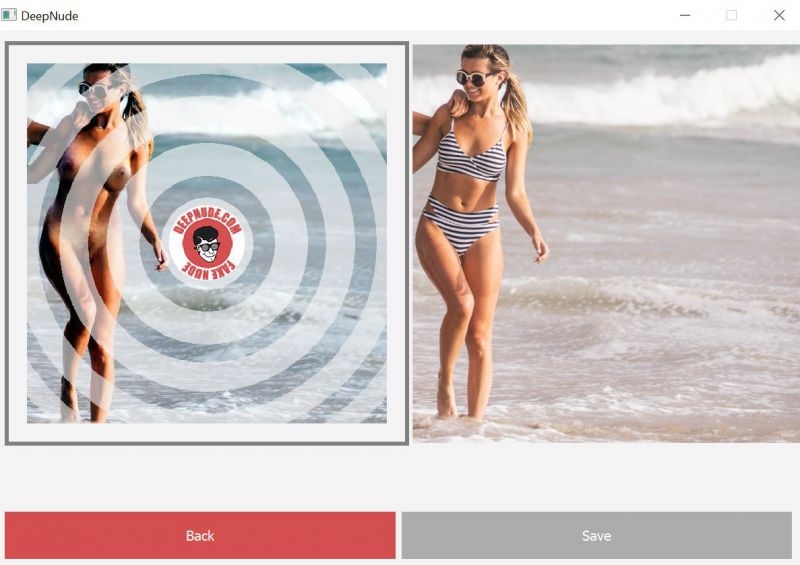

Esta plataforma prometia pegar qualquer foto normal de uma mulher e transformar em um nude para os mais curiosos, graças ao recurso de inteligência artificial e aprendizagem automática. E o mais perturbador de tudo isso é que muitos usuários entendiam que os resultados eram bem realistas, mesmo não sendo reais. O sistema usa o mesmo conceito do deepfake que estamos comentando há muito tempo aqui no blog.

Conteúdo pornográfico não consensual

Os sinais de alarme detonaram de imediato. A internet ficou lotada de comentários muito preocupados sobre as possibilidades de uso ilícito da ferramenta.

Pois bem, menos de 24 horas depois de sua popularidade instantânea, o DeepNude está morto. Uma publicação em sua conta no Twitter por parte dos seus responsáveis confirmou o seu fim e a extinção da plataforma, com a afirmação clássica (e bem óbvia) de “o mundo não está preparado para este aplicativo”.

Até o momento do seu fim, o DeepNude era utilizado por mais de meio milhão de usuários. Não foi revelado o número de fotos que foram alteradas. Sem falar nos usuários que estão utilizando a versão pirata do programa, que remove a marca d’água das fotos.

Os responsáveis do site afirmaram o óbvio: as probabilidades das pessoas fazerem um mau uso do DeepNude eram enormes, e por causa disso eles decidiram sair do negócio e devolver o dinheiro para todos os usuários que pagaram a versão Premium do aplicativo.

https://twitter.com/deepnudeapp/status/1144307316231200768

Era uma questão de tempo até que os criadores do DeepNude tivessem o bom senso para acabar com essa palhaçada. Porém, é sempre importante lembrar que a sua tecnologia que despia mulheres em fotos veio de um código aberto. Ou seja, com certeza outras soluções similares vão aparecer nos próximos meses.

O Pornhub proíbe vídeos de deepfakes gerados por inteligência artificial, pois considera essa prática abusiva. E seria interessante que outras plataformas que promovem conteúdos pornográficos adotem a mesma política, para coibir o uso equivocado ou errado da tecnologia.