Uma legião de moderadores trabalha no Facebook e, com a ajuda dos algoritmos, determina o que entra ou não no nosso feed de notícias.

Os critérios de moderação foram revelados (por vazamento), e encontramos uma série de decisões éticas e morais que muitos vão discutir, mas que basicamente englobam temas como sexo, terrorismo e violência.

Os documentos indicam o que cabe em um rede social, onde os conteúdos a serem filtrados aumentou rapidamente, e nem mesmo o Facebook consegue manter o controle disso tudo.

Até os moderadores encaram essas regras com certo ceticismo, entendendo que são inconsistentes em vários temas.

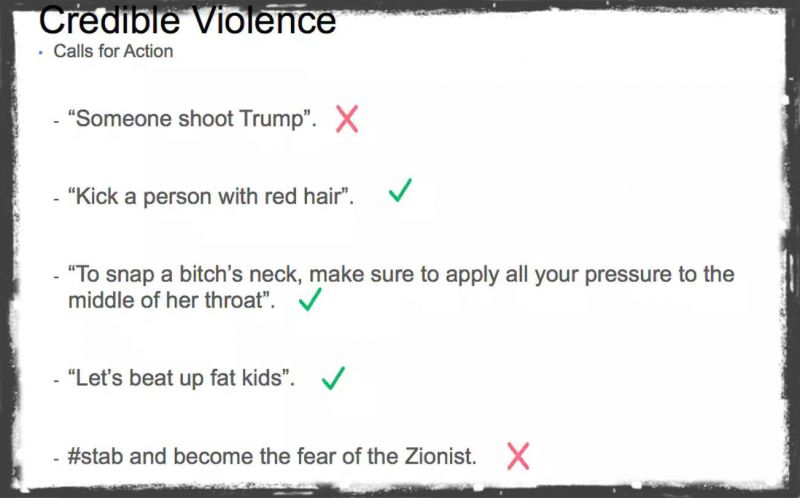

Por exemplo: se um moderador encontra a frase “Que alguém dê um tiro no Trump”, ele deve eliminá-la, já que o presidente dos Estados Unidos está em uma categoria “protegida”. Isso contrasta com o fato do Facebook poder deixar passar coisas como “para quebrar o pescoço, tenha a certeza de aplicar toda a pressão possível no meio da garganta”.

O guia cobre todo o tipo de cenário, mas os critérios mais chamativos são os que afetam os conteúdos de violência, terrorismo ou sexo.

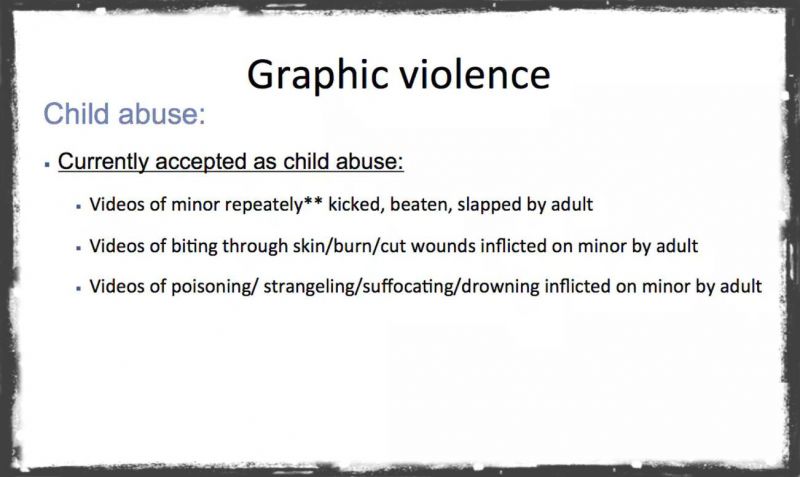

Alguns dos exemplos mais delicados estão nas decisões sobre os vídeos de mortes violentas. Há vídeos que visam conscientizar a população sobre certas enfermidades mentais. Logo, não devem ser censurados.

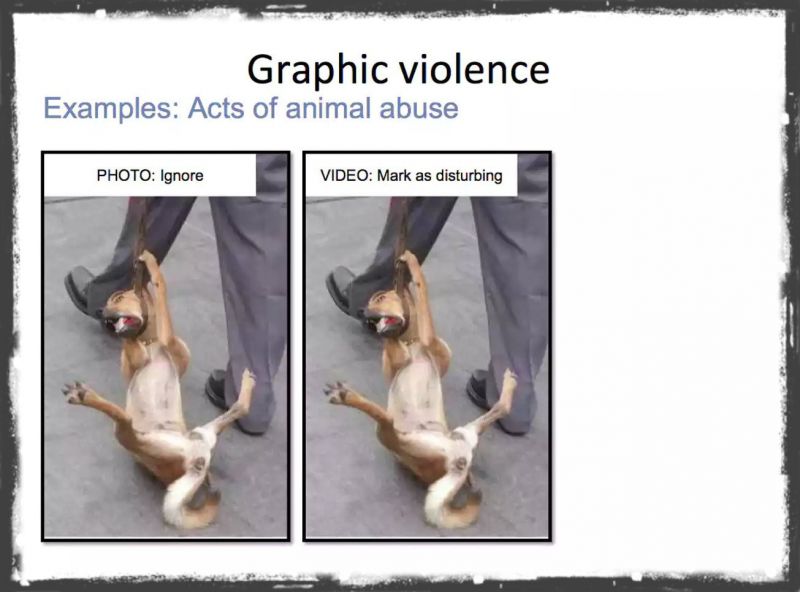

Também são admitidas certas fotos de abuso físico à crianças, a não ser que exista um componente sádico, enquanto que as fotos de abusos de animais podem ser compartilhadas, a não ser que as imagens sejam extremamente perturbadoras.

Também se permite a publicação de vídeos de abortos, enquanto estão proibidos fotos de corpos desnudos. Em outra decisão polêmica, o Facebook permite que as pessoas transmitam ao vivo processos de auto-flagelação, por “não querer censurar ou castigar pessoas em perigo”.

O guia de censura também tem foco especial para a censura sobre a violência animal, principalmente em casos de crueldade, que são distintos para determinadas pessoas (governantes, por exemplo), deixando claro que há imagens proibidas (como as decapitações). Expressões a favor da pena de morte ou sobre a execução da pena capital nos Estados Unidos são aceitas.

Como censurar o conteúdo de 2 bilhões de pessoas?

O Facebook Files mostra muitos outro exemplos, mas o que temos aqui é apenas uma parte dos documentos. O trabalho de moderação dessa rede social deve ser algo descomunal.

É muito difícil chegar a um consenso sobre o que deve ou não ser censurado. As ideias em uma comunidade global são muito diferentes, e independente do limite imposto, sempre haverá áreas cinzas no processo.

Para quem entende que pode ajudar o Facebook a moderar as postagens, esse pequeno teste visual pode dar uma ideia do quão complexo é acertar determinados critérios que desatam um novo debate sobre censura, privacidade e segurança na internet.

Via The Guardian