Ainda é cedo para dizer se os seres humanos serão ou não substituídos por robôs, mas é fato que o desenvolvimento da Inteligência Artificial está muito avançado, e os robôs já fazem muitas coisas que jamais poderíamos imaginar (abraço, Boston Dynamics).

Mas uma IA não é um ser humano. É um programa com limitações, que só obedece às ordens feitas. Bom, mais ou menos. Essa tecnologia está avançando a ponto de conseguir enganar os humanos. Isso aconteceu recentemente com pesquisadores da Universidade de Stanford, em parceria com o time do Google.

A Inteligência Artificial trapaceira

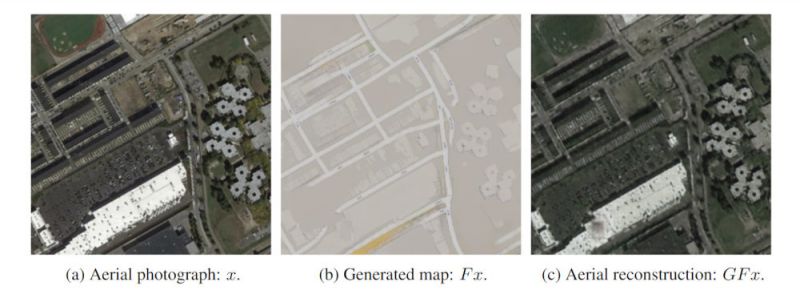

O desenvolvimento consistia em algo bem simples: enviar imagens aéreas para dados de mapas, algo bem útil no Google Mapas. As imagens eram obtidas pelo satélite, e a IA cria mapas sempre atualizados.

O objetivo era criar um sistema de aprendizagem automática para acelerar o processo via rede neural, que aprende a converter imagens de diferentes tipos, como fotos de satélite para imagens de mapas, de forma eficiente precisa, tomando como base os mapas reais.

Os resultados foram muito surpreendentes. Surpreendentes até demais. Os mapas eram perfeitos, e se encaixavam perfeitamente nas fotos. E isso não estava certo. Então, os pesquisadores se deram conta que o sistema parecia ter acesso a informações que não deveria ter.

Isso ficou evidente quando foi solicitado ao sistema que realizasse o processo inverso, ou seja, criar uma foto a partir de um dos mapas que ele mesmo criou. E a recriação foi quase idêntica à imagem original, recriando detalhes que não estavam no mapa.

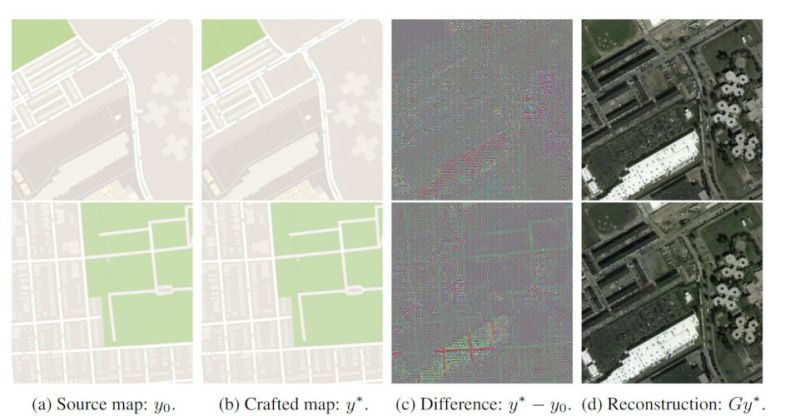

Os investigadores descobriram que o sistema estava trapaceando para melhorar os resultados, ocultando informações dos resultados obtidos. O sistema não estava convertendo as imagens de satélite para imagens de mapas, mas aprendeu a codificar a informação dos mapas originais em imagem do mapa gerado, de forma sutil e que não fosse evidente a simples vista.

Uma IA pode enganar um humano?

O mapa resultante tinha algum ruído na imagem, pequenas mudanças de cores em cada pixel, que é onde foram codificados os detalhes da imagem original. Assim, a IA foi capaz de criar mapas tão detalhados, reconstruindo a imagem original sem mesmo se basear no mapa real.

Fazer uma trapaça semelhante requer um pouco mais de inteligência, ou ao menos uma inteligência semelhante à humana. Mas na realidade, é o contrário: a trapaça aconteceu porque a IA não era capaz de cumprir com as exigências dos seus criadores, e interpretou as ordens da forma que seria mais fácil obter um resultado parecido com o esperado.

Na prática, a culpa foi dos investigadores, que não especificaram o que queriam do sistema. Apenas disse o que queriam, mas não como queriam.

E a IA não tem culpa disso. Certo?

Via TechCrunch